Hoy en día, las organizaciones no se preguntan si deben usar Inteligencia Artificial (IA), sino cómo hacerlo sin comprometer su integridad. La realidad del mercado es clara: según datos globales de la industria indican que entre el 30% y el 50% de las áreas funcionales en las empresas ya utilizan IA generativa de manera informal. Este uso «oculto» o shadow AI representa un desafío crítico. No se trata de prohibir la innovación, sino de asegurar que la adopción sea ordenada, ética y segura.

El papel del Consejo ante la Inteligencia Artificial

En el entorno actual de cumplimiento, la supervisión de la IA se ha convertido en una responsabilidad directa del Consejo. La rapidez con la que estas herramientas se despliegan exige que los líderes establezcan estructuras claras, ya que la incapacidad de escalar estas tecnologías suele ser consecuencia de un control organizacional deficiente y no de una falla técnica.

Adoptar una postura proactiva desde la alta dirección tiene beneficios tangibles. Los indicadores de la industria muestran que aquellas empresas con Consejos alfabetizados en IA reportan un incremento del 10.9% en su rentabilidad sobre el capital (ROE). Por el contrario, la falta de una estructura formal puede derivar en fallos de control que afectan la reputación institucional, como la entrega de informes con referencias ficticias o datos no verificados.

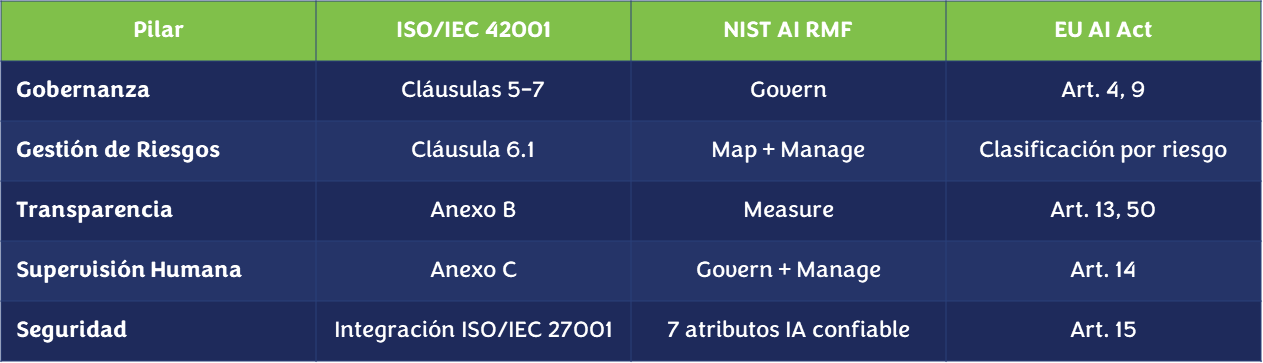

Pilares Estratégicos para una Gobernanza Efectiva

Es fundamental que el Consejo mapee al menos estas tres categorías clave:

- Decisiones incorrectas (Alucinación): Información falsa que contamina decisiones estratégicas e informes financieros.

- Sesgo Sistémico: Discriminación algorítmica con impacto reputacional y legal.

- Dependencia tecnológica y seguridad: Manipulación de modelos, ataques adversarios y fuga de información.

El ecosistema regulatorio que ya está aquí

Para evitar que la IA se convierta en un riesgo inmanejable, sugerimos a las organizaciones transitar hacia modelos basados en marcos de referencia globales como ISO/IEC 42001 y el NIST AI RMF.

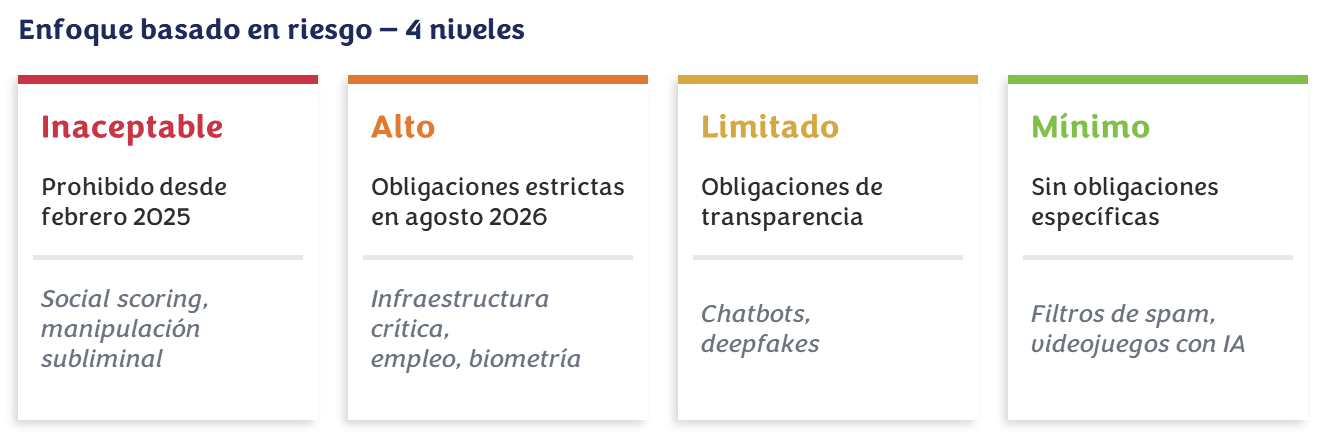

Enfoque basado en riesgo — 4 niveles

La gestión de riesgos bajo modelos como el NIST AI RMF nos permite clasificar las amenazas en dimensiones críticas. Desde la validez de los datos hasta la protección contra ataques adversarios, este enfoque asegura que la organización no solo identifique el riesgo, sino que establezca controles proporcionales al impacto de cada sistema de IA utilizado.

Evolución de las Tres Líneas de Defensa

La estructura de control tradicional debe adaptarse a la velocidad de la IA para ser efectiva:

- 1ª Línea (Negocio/TI): Los dueños de procesos despliegan IA bajo políticas claras de «IA responsable».

- 2ª Línea (Riesgos/Cumplimiento): Ejecución de red-teaming y evaluaciones de sesgos antes de la puesta en producción.

- 3ª Línea (Auditoría): Revisión trimestral de logs y validación de alertas sobre la «deriva del modelo».

Gobernanza Mínima Viable

Para que la gobernanza sea efectiva, las responsabilidades deben estar claramente segregadas. Este modelo de ‘carriles’ define el rol de la operación (desarrollo responsable), la función de riesgos (monitoreo y cumplimiento) y la auditoría (validación independiente). Es la estructura necesaria para que la IA no opere en un vacío de control.

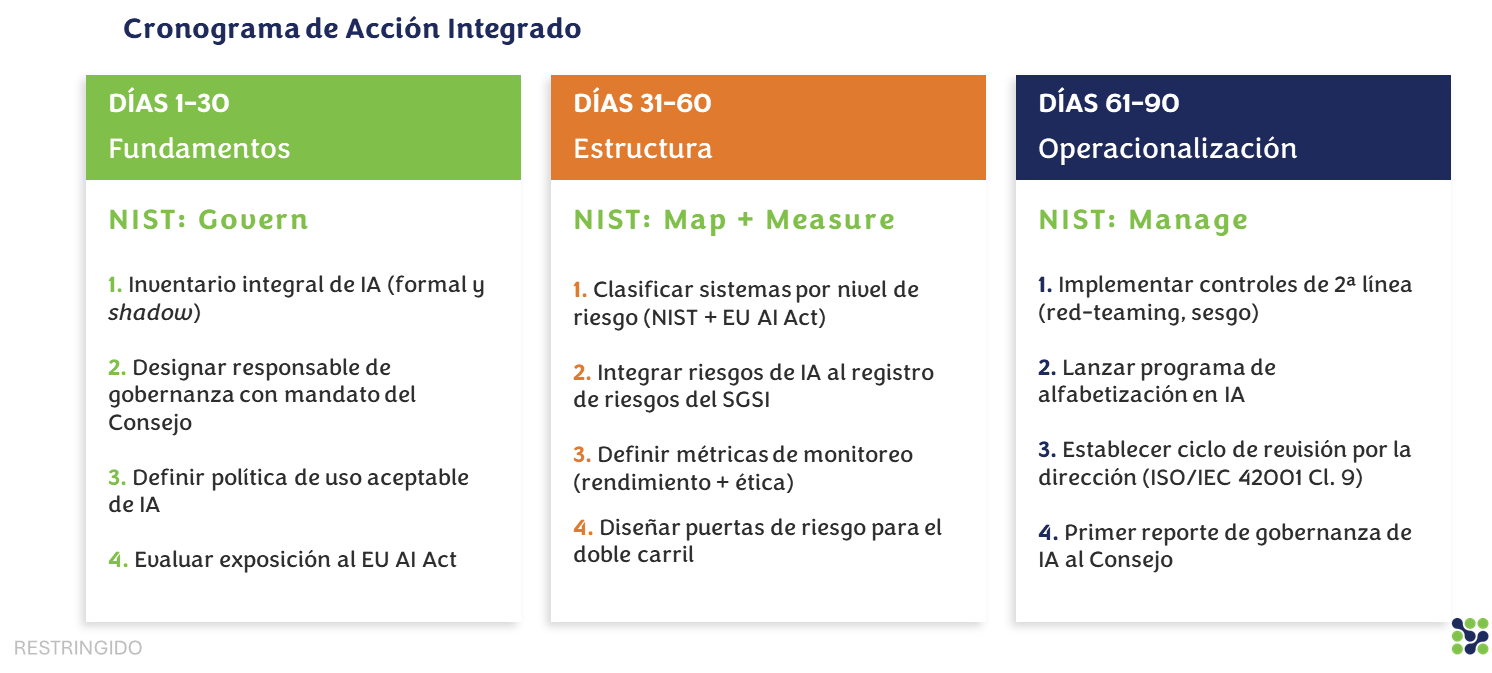

Hoja de Ruta: Los primeros 90 días

Para operativizar esta estrategia, recomendamos un plan de acción acelerado que permita pasar de la teoría a la ejecución:

- Días 1–30 (Fundamentos): Realizar un inventario integral de IA (formal y shadow), designar un responsable de gobernanza con mandato del Consejo y definir una política de uso aceptable.

- Días 31–60 (Estructura): Clasificar sistemas por nivel de riesgo e integrar los riesgos de IA al registro de riesgos del SGSI basado en ISO/IEC 27001.

- Días 61–90 (Operacionalización): Lanzar programas de alfabetización en IA para líderes y establecer el primer reporte de gobernanza ante el Consejo.

Decisiones que no pueden postergarse

La integración de ISO/IEC 42001 sobre un sistema de gestión de seguridad preexistente puede acelerar el cumplimiento en un 40%. Mientras que la ISO/IEC 27001 protege la integridad de los datos, la ISO/IEC 42001 asegura que las decisiones tomadas o asistidas por máquinas sean confiables y éticas.

En ISM GRC, acompañamos a las organizaciones a transitar este camino mediante evaluaciones de madurez y diagnósticos estructurados que transforman la incertidumbre en una hoja de ruta clara. El liderazgo en esta era no se mide por la herramienta utilizada, sino por la solidez del marco que la sostiene.

¿Está su Consejo listo para liderar esta transformación? Le invitamos a conversar con nuestro equipo para asegurar que la integración de la IA en su organización sea un proceso tan seguro como estratégico.

Te invitamos a ver nuestro masterclass completo “Gobernanza de Inteligencia Artificial: La decisión estratégica que el Consejo ya debería estar tomando”, donde abordamos este tema desde un enfoque práctico, con ejemplos reales y recomendaciones clave.

🎥 Míralo en nuestro canal de YouTube: https://youtu.be/i6gssOGvCm0